はじめに

以前の記事でWindowsにOllamaをインストールする手順を紹介しました。今回はOllamaを、LLMアプリケーション開発プラットフォームであるDifyと連携させる方法を紹介します。

WSL上で動作するDifyからWindows側のOllamaにアクセスするための設定と、チャットアプリとして画像認識まで動作させる手順をまとめます。

前提条件

- Ollama がWindowsにインストール済みであること

- Dify がWSL上のDockerなどで動作していること

手順

1. OLLAMA_HOST を設定する

Ollamaはデフォルトでは127.0.0.1(localhost)でリッスンしているため、外部からアクセスできません。今回はWSL上からアクセスするため、環境変数 OLLAMA_HOST に0.0.0.0を設定します。こうすることですべてのインターフェースでリッスンするようになり、WSLからもアクセスできるようになります。

2. モデルプロバイダーに Ollama を追加する

Difyの設定画面からモデルプロバイダーを開き、一覧からOllamaを選択して追加します。

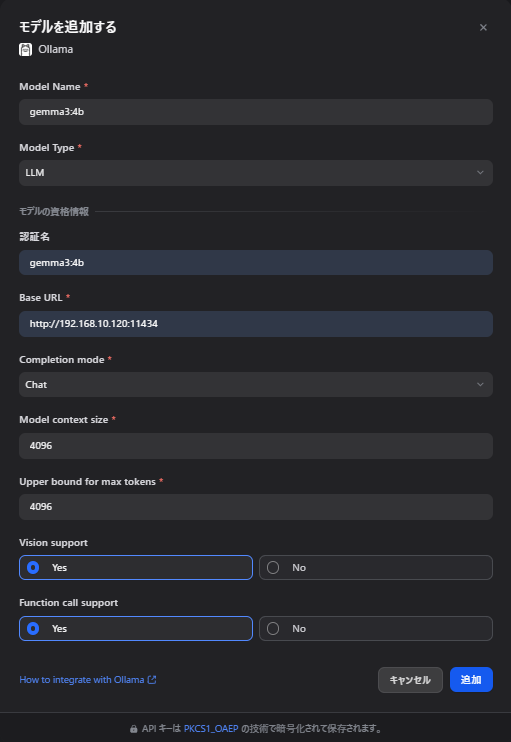

3. Ollama のエンドポイントを設定する

モデル追加画面で、OllamaのエンドポイントURLを以下の形式で入力します。

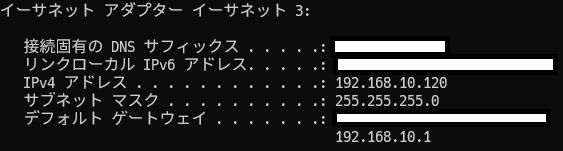

http://ホストPCのIPアドレス:11434NOTE: ホストPCのIPアドレスはコマンドプロンプト(PowerShell)で

ipconfigを実行して確認できます。

今回使用する gemma3:4b は画像の読み取りにも対応しているため、Visionサポートも有効にしています。

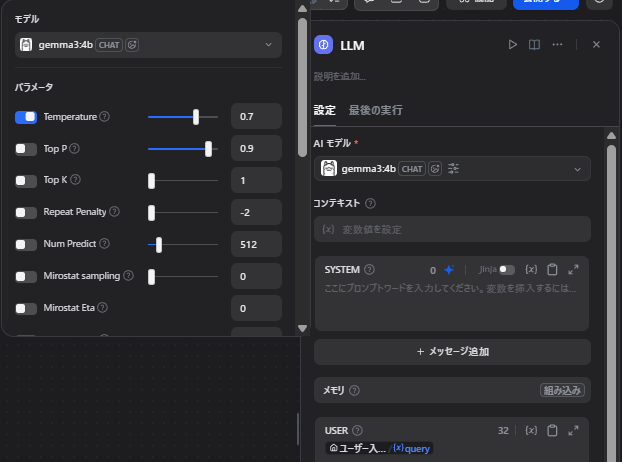

4. チャットアプリを作成する

Difyで新しいチャットアプリを作成し、使用するモデルとして gemma3:4b を指定します。

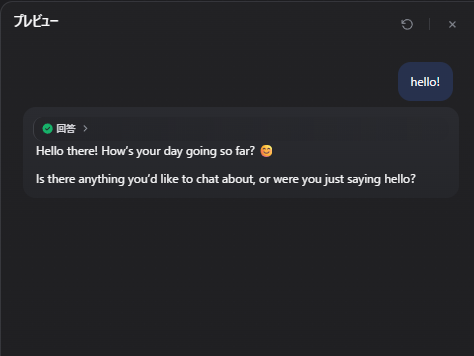

5. テキストで動作確認する

テキストを入力して送信すると、モデルから応答が返ってきました。

6. 画像入力を有効にして動作確認する

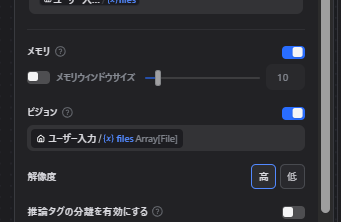

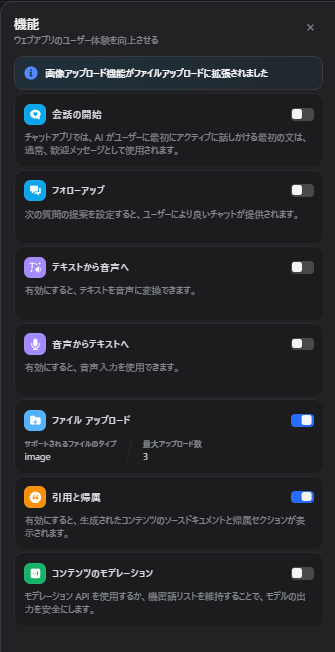

ユーザーからのファイル入力を受け付けるよう設定を変更します。

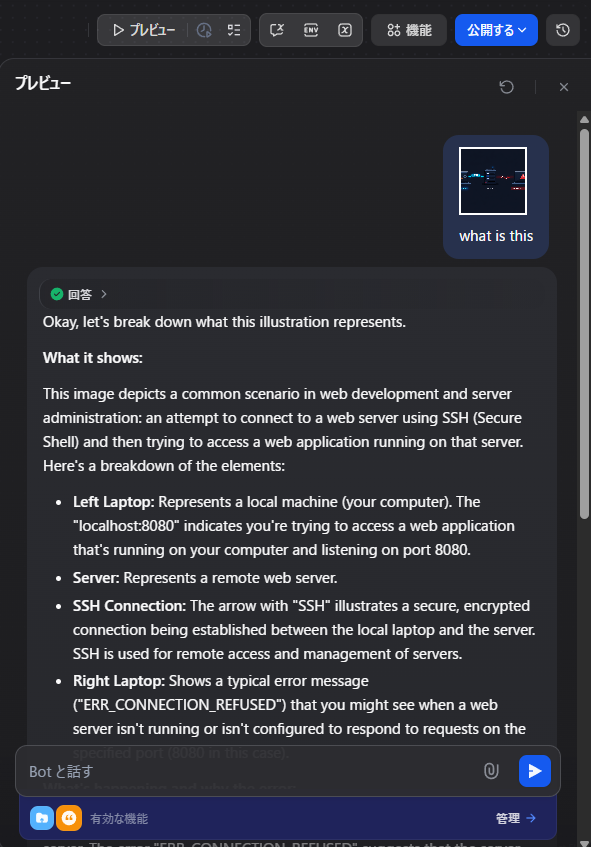

設定後、画像ファイルを送信してみます。少し時間はかかりましたが、モデルが画像の内容を正しく認識して応答を返してくれました。

まとめ

DifyにOllamaをモデルとして登録することで、ローカルのLLMをDifyのチャットアプリから利用できるようになります。gemma3:4b はVisionサポートも備えており、画像認識も問題なく動作しました。OllamaはローカルでLLMを動かせるため、金銭的なコストの削減や、プライバシーの確保などのメリットがあります。LLMで遊ぶのには最適だと思うので、ぜひ試してみてください。

コメント