はじめに

ローカルでLLMを動かせる Ollama をWindowsにインストールしたので、その手順をまとめます。 インストール時にスマート アプリ コントロールによるブロックや、GPU認識まわりでいくつかハマりどころがあったため、あわせて記録しておきます。

インストール

https://ollama.com/download/windows からインストーラーをダウンロードします。

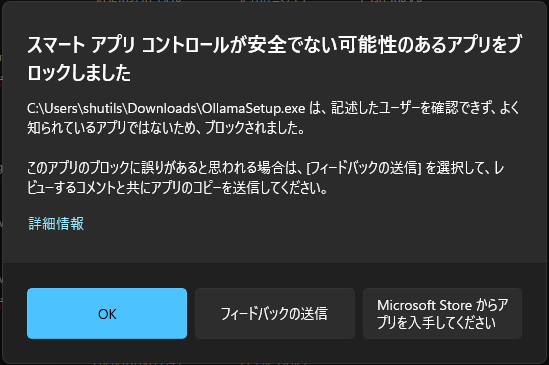

ダウンロードしたインストーラーを実行すると、Windowsのスマート アプリ コントロールにブロックされました。

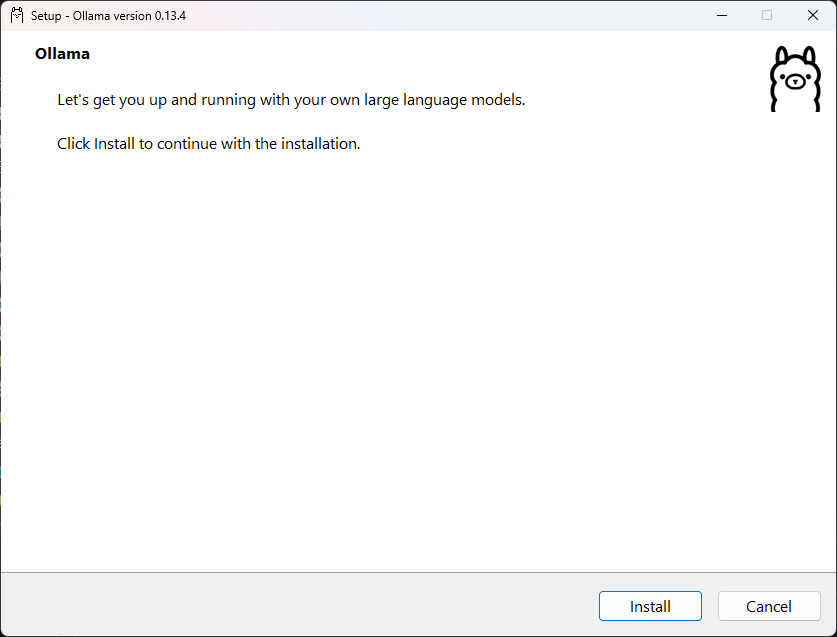

GitHubのissueを確認すると同様の事例が報告されていました。 v0.13.4であればブロックされないとのことなので、GitHubのリリースページからv0.13.4のインストーラーをダウンロードして実行します。

v0.13.4のインストーラーはブロックされずにインストールできました。

UIでの動作確認

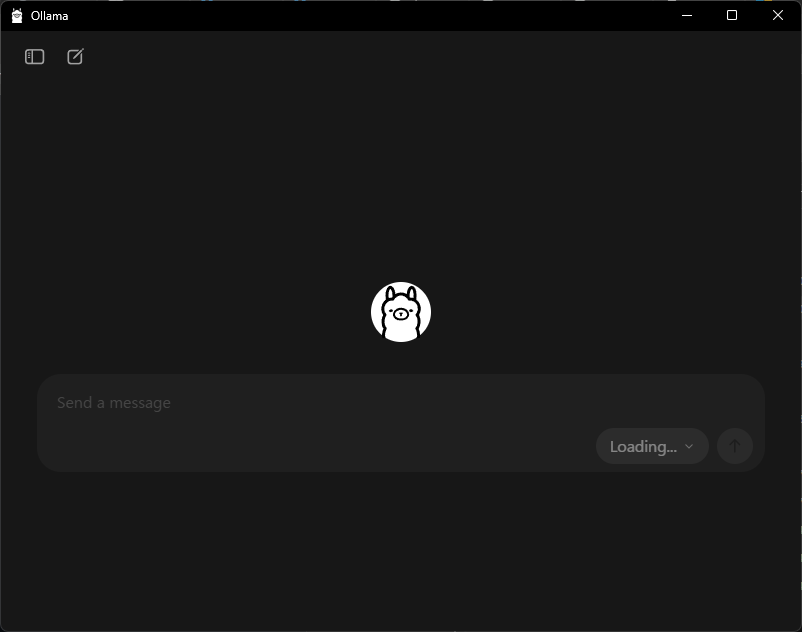

インストール後、Windowsの検索窓から「Ollama」を起動するとUIが立ち上がります。

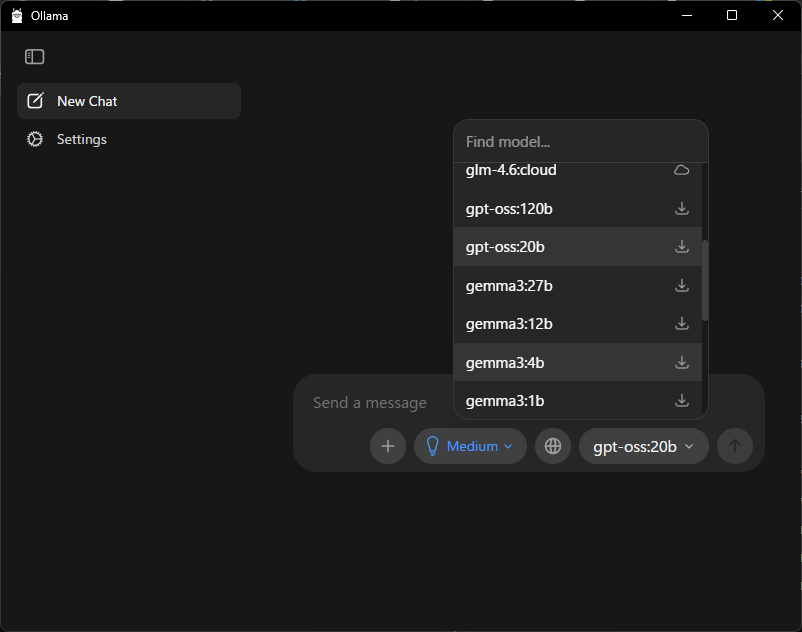

使用するモデルを選択します。今回は gemma3:4b を選択しました。

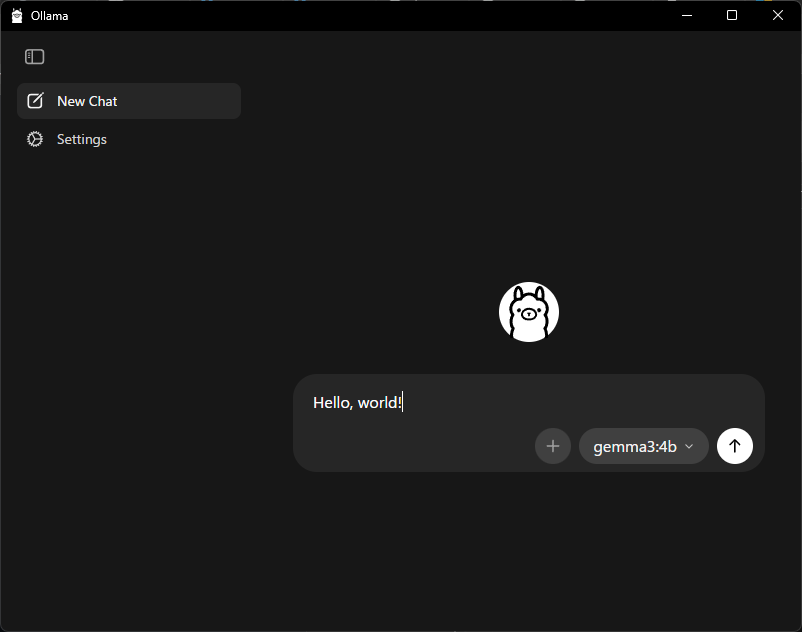

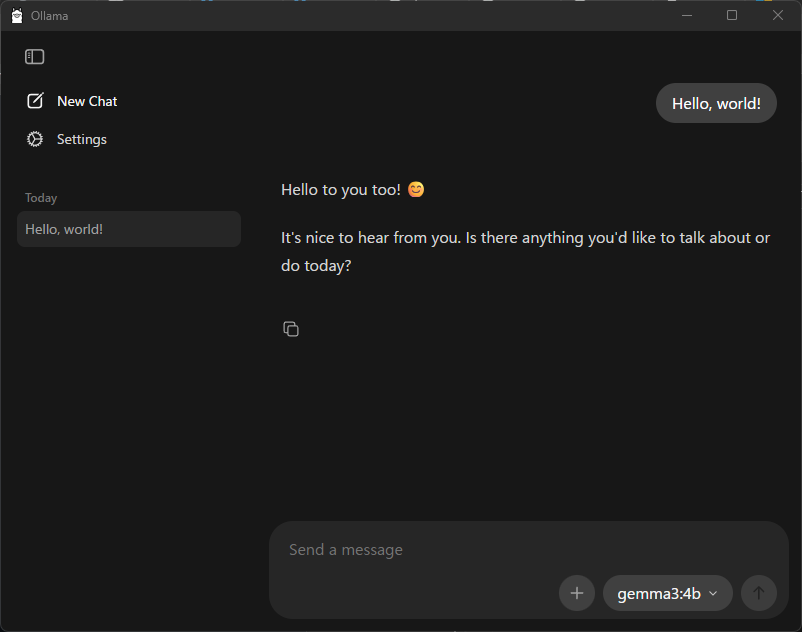

UIのメッセージ欄に「Hello, world!」と入力して送信すると、モデルからの応答が返ってきました。

Note: 初回はモデルのダウンロードが行われるため、応答が返ってくるまでに時間がかかります。

CLIでの動作確認

コマンドプロンプト(PowerShell)からも操作できます。

インストールされているモデルの一覧を確認します。

PS C:\Users\shutils> ollama.exe list

NAME ID SIZE MODIFIED

gemma3:4b a2af6cc3eb7f 3.3 GB 15 minutes agoモデルを対話モードで実行します。

PS C:\Users\shutils> ollama.exe run gemma3:4b

>>> hello

Hello there! How's it going today? Is there anything I can help you with, or were you just saying hello? 😊

Let me know if you'd like to chat, need information, or want to play a game!

>>> Send a message (/? for help)その他のコマンドは --help で確認できます。

PS C:\Users\shutils> ollama.exe --help

Large language model runner

Usage:

ollama [flags]

ollama [command]

Available Commands:

serve Start ollama

create Create a model

show Show information for a model

run Run a model

stop Stop a running model

pull Pull a model from a registry

push Push a model to a registry

signin Sign in to ollama.com

signout Sign out from ollama.com

list List models

ps List running models

cp Copy a model

rm Remove a model

help Help about any command

Flags:

-h, --help help for ollama

-v, --version Show version information

Use "ollama [command] --help" for more information about a command.サーバーモードでの起動

ollama serve コマンドでHTTP APIサーバーとして起動できます。 ただし初回のUI起動時にポートが使用済みのままになっていたため、以下のエラーが発生しました。

PS C:\Users\shutils> ollama.exe serve

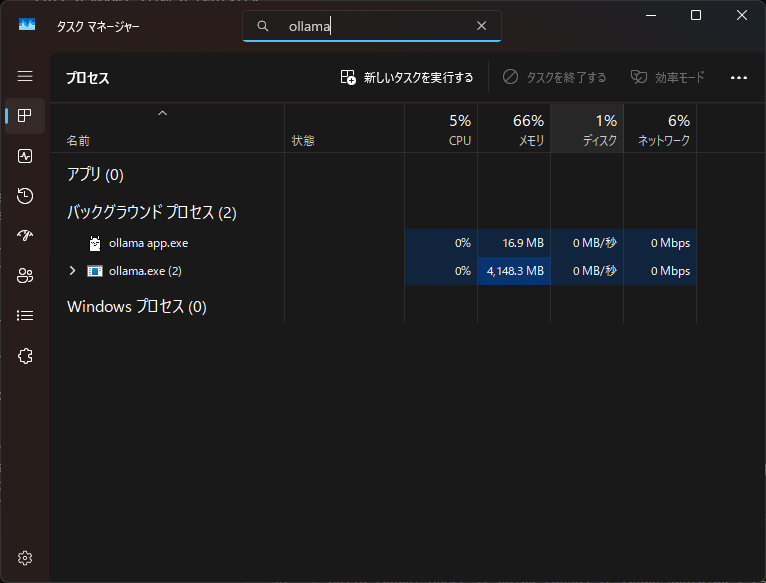

Error: listen tcp 127.0.0.1:11434: bind: Only one usage of each socket address (protocol/network address/port) is normally permitted.タスクマネージャーから ollama.exe を終了させた後、再度コマンドを実行するとサーバーモードで起動できました。

GPUを有効化する

起動直後はGPUが使用されていなかったため、以下のコマンドで環境変数を設定します。

setx OLLAMA_VULKAN 1設定後にサーバーを再起動すると、GPUが使用されるようになりました。

まとめ

WindowsへのOllamaのインストールと基本的な動作確認ができました。 インストール時はスマート アプリ コントロールのブロックに注意が必要ですが、v0.13.4を使用することで回避できます。 また、GPU利用には OLLAMA_VULKAN 環境変数の設定が必要でした。

今後はこの環境を使って、OllamaのAPIを活用したツールや連携方法についても紹介していく予定です。

コメント